YOLOv5改进之添加SE注意力机制是什么

本篇内容主要讲解“YOLOv5改进之添加SE注意力机制是什么”,感兴趣的朋友不妨来看看。本文介绍的方法操作简单快捷,实用性强。下面就让小编来带大家学习“YOLOv5改进之添加SE注意力机制是什么”吧!

解决问题:

加入SE通道注意力机制,可以让网络更加关注待检测目标,提高检测效果

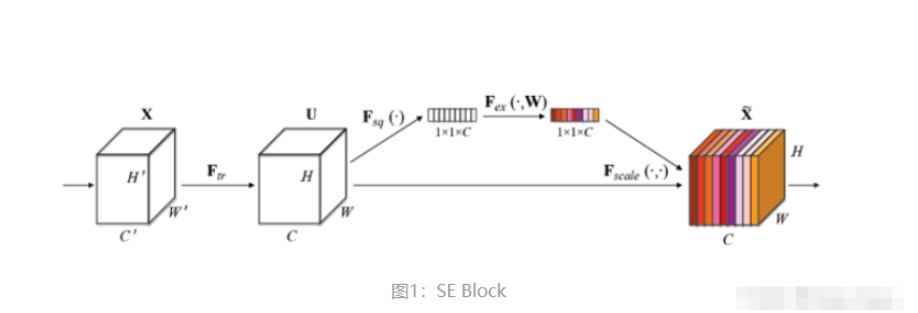

SE模块的原理和结构

添加方法:

第一步:确定添加的位置,作为即插即用的注意力模块,可以添加到YOLOv5网络中的任何地方。本文以添加进C3模块中为例。

第二步:common.py构建融入se模块的C3,与原C3模块不同的是,该模块中的bottleneck中融入se模块。这样添加主要为了更好的做实验。

class seC3(nn.Module): # CSP Bottleneck with 3 convolutions def __init__(self, c1, c2, n=1, shortcut=True, g=1, e=0.5): # ch_in, ch_out, number, shortcut, groups, expansion super(seC3, self).__init__() c_ = int(c2 * e) # hidden channels self.cv1 = Conv(c1, c_, 1, 1) self.cv2 = Conv(c1, c_, 1, 1) self.cv3 = Conv(2 * c_, c2, 1) # act=FReLU(c2) self.m = nn.Sequential(*[seBottleneck(c_, c_, shortcut, g, e=1.0) for _ in range(n)]) # self.m = nn.Sequential(*[CrossConv(c_, c_, 3, 1, g, 1.0, shortcut) for _ in range(n)]) def forward(self, x): return self.cv3(torch.cat((self.m(self.cv1(x)), self.cv2(x)), dim=1)) class seBottleneck(nn.Module): # Standard bottleneck def __init__(self, c1, c2, shortcut=True, g=1, e=0.5): # ch_in, ch_out, shortcut, groups, expansion super(seBottleneck, self).__init__() c_ = int(c2 * e) # hidden channels self.cv1 = Conv(c1, c_, 1, 1) self.cv2 = Conv(c_, c2, 3, 1, g=g) self.add = shortcut and c1 == c2 self.avgpool = nn.AdaptiveAvgPool2d(1) self.l1 = nn.Linear(c1, c1 // 4, bias=False) self.relu = nn.ReLU(inplace=True) self.l2 = nn.Linear(c1 // 4, c1, bias=False) self.sig = nn.Sigmoid() def forward(self, x): x = self.cv1(x) b, c, _, _ = x.size() y = self.avgpool(x).view(b, c) y = self.l1(y) y = self.relu(y) y = self.l2(y) y = self.sig(y) y = y.view(b, c, 1, 1) x = x * y.expand_as(x) return x + self.cv2(x) if self.add else self.cv2(self.cv1(x))

第三步:yolo.py中注册我们进行修改的seC3

if m in [Conv, GhostConv, Bottleneck, Bottleneck_cot,TransformerC3,GhostBottleneck, SPP, DWConv, MixConv2d, Focus, CrossConv, BottleneckCSP, C3,seC3]: c1, c2 = ch[f], args[0] if c2 != no: # if not output c2 = make_divisible(c2 * gw, 8) args = [c1, c2, *args[1:]] if m in [BottleneckCSP, seC3]: args.insert(2, n) # number of repeats n = 1

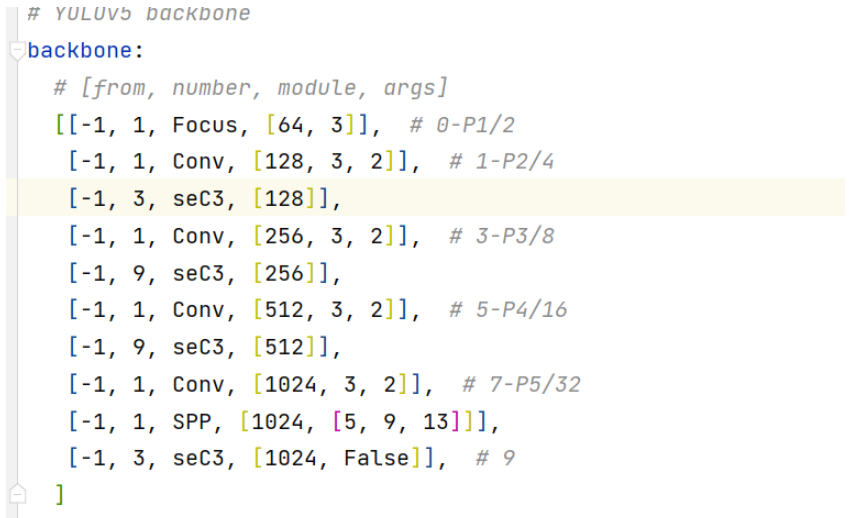

第四步:修改yaml文件,本文以修改主干特征提取网络为例,将原C3模块改为seC3即可。

第五步:将train.py中改为本文的yaml文件即可,开始训练。

结果:

本人在多个数据集上做了大量实验,针对不同的数据集效果不同,同一个数据集的不同添加位置方法也是有差异,需要大家进行实验。有效果有提升的情况占大多数。

PS:SE通道注意力机制,参数量引入较少,不仅仅是可以添加进YOLOv5,也可以添加进任何其他的深度学习网络,不管是分类还是检测还是分割,主要是计算机视觉领域,都可能会有不同程度的提升效果。

到此,相信大家对“YOLOv5改进之添加SE注意力机制是什么”有了更深的了解,不妨来实际操作一番吧!这里是蜗牛博客网站,更多相关内容可以进入相关频道进行查询,关注我们,继续学习!

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:niceseo99@gmail.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。版权声明:如无特殊标注,文章均为本站原创,转载时请以链接形式注明文章出处。

评论