如何进行spark SQL编程动手实战

如何进行spark SQL编程动手实战,相信很多没有经验的人对此束手无策,为此本文总结了问题出现的原因和解决方法,通过这篇文章希望你能解决这个问题。

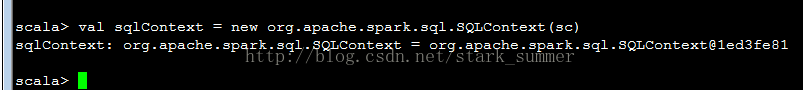

首先创建SparkContext上下文:

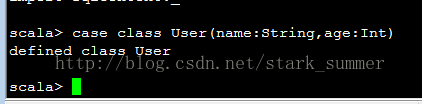

接着引入隐身转换,用于把RDD转成SchemaRDD:

接下来要加载数据,这里的测试数据是user.txt文件:

我们创建好use.txt增加内容并上传到hdfs中:

hdfs命令查询:

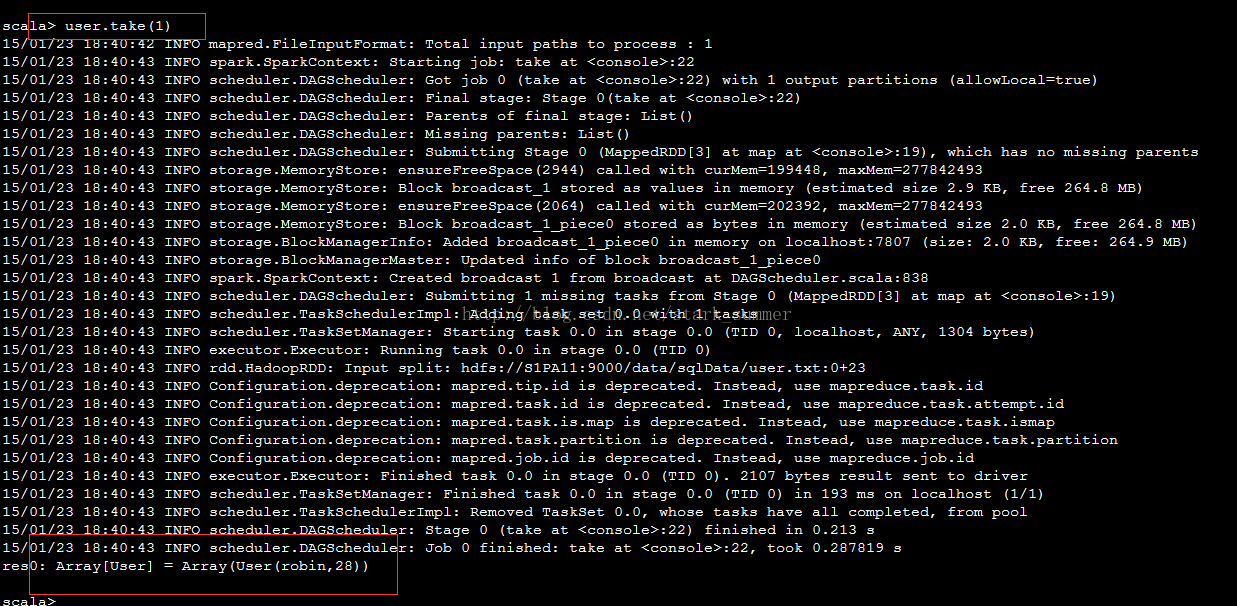

验证数据是否加载成功:

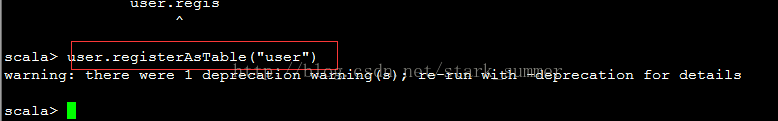

此刻user还是一个MappedRDD:

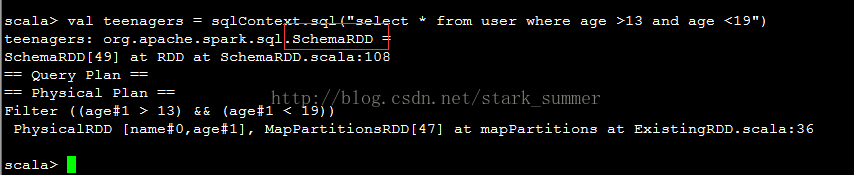

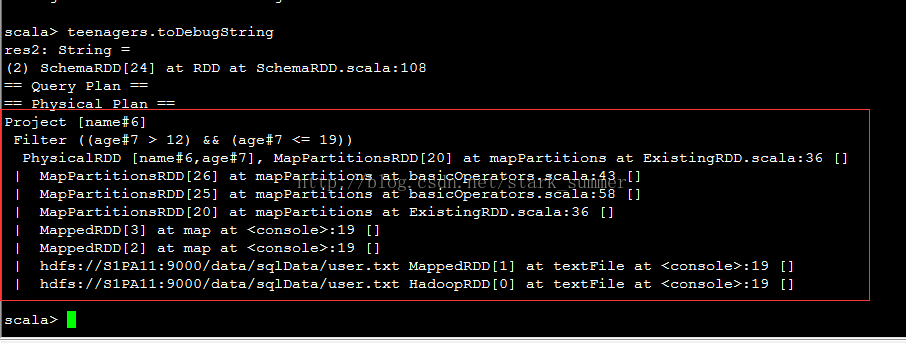

此刻的teenagers已经隐身转换成SchemaRDD

结果:

同样使用"user.txt"的数据:

我们这次直接使用SQL查询操作:

可以发现使用DSL的使用teenagers在内部已经被隐身转换了SchemaRDD的实例

可以发现与前面那张注册Table方式的结果是一样的

看完上述内容,你们掌握如何进行spark SQL编程动手实战的方法了吗?如果还想学到更多技能或想了解更多相关内容,欢迎关注蜗牛博客行业资讯频道,感谢各位的阅读!

免责声明:本站发布的内容(图片、视频和文字)以原创、转载和分享为主,文章观点不代表本网站立场,如果涉及侵权请联系站长邮箱:niceseo99@gmail.com进行举报,并提供相关证据,一经查实,将立刻删除涉嫌侵权内容。版权声明:如无特殊标注,文章均为本站原创,转载时请以链接形式注明文章出处。

评论